Criminelen maken volop gebruik van AI

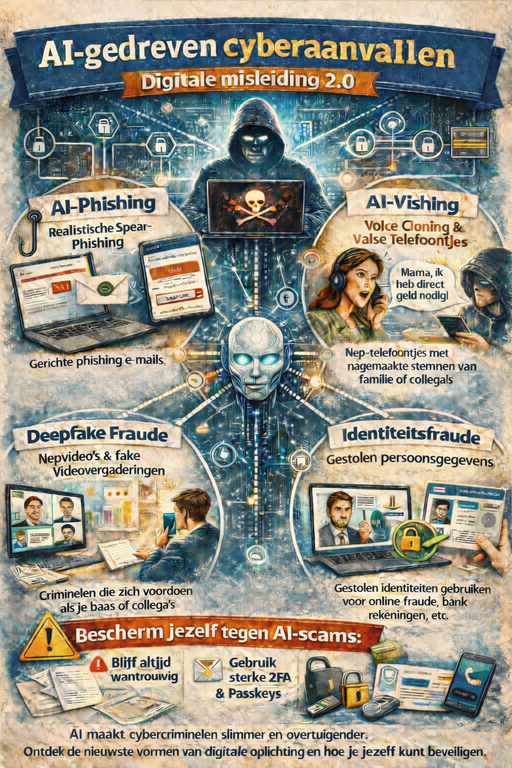

AI maakt cybercriminaliteit steeds slimmer, sneller en veel goedkoper. Deepfake-aanvallen komen dan ook steeds vaker voor. Ook voice-phishing, een vorm van oplichting waarbij criminelen de telefoon gebruiken om slachtoffers te misleiden en geld, inloggegevens of andere gevoelige informatie te ontfutselen zijn inmiddels aan de orde van de dag. Zelfs grote bedrijven laten zich steeds vaker misleiden door nep-videovergaderingen met perfect nagemaakte collega’s. Daarom is het belangrijk dat je weet wat AI-gedreven cyberaanvallen precies zijn, hoe ze precies door criminelen worden ingezet en welke nieuwe risico’s daaruit ontstaan. Want alleen als je weet wat de gevaren zijn van deze geavanceerde op kunstmatige intelligentie gebaseerde misdaad, kun je effectieve maatregelen treffen om jezelf er zo goed mogelijk tegen te beschermen.

Wat zijn AI-gedreven cyberaanvallen precies?

Een AI-gedreven cyberaanval is een aanval waarbij criminelen kunstmatige intelligentie gebruiken om hun slachtoffers te ‘targeten’, berichten geloofwaardiger te maken en stemmen, gezichten of documenten te vervalsen. Daarnaast wordt AI gebruikt om aanvallen te automatiseren en op te schalen. Hieronder lees je hoe je AI-gedreven cyberaanvallen kunt herkennen en wat je kunt doen om te voorkomen dat je slachtoffer wordt van deze vorm van digitale criminaliteit.

AI-vhishing (met behulp van voice cloning)

AI-gedreven cyberaanvallen herkennen en voorkomen

Hoe bescherm ik mezelf tegen AI-phishing?

Bescherming tegen AI-vishing (voice cloning)

Hoe bescherm ik mezelf tegen deepfake-criminaliteit?

Hoe kunnen organisaties zich beschermen tegen AI-gedreven cyberaanvallen?

Voorkomen dat je identiteitsfoto wordt misbruikt op social media

AI-gedreven automatisering van grootschalige cyberaanvallen

Risico’s rondom biometrie en deepfake-spoofing

Risico’s van AI-integratie in kritieke infrastructuren en IoT

Maatschappelijke risico’s van AI op de lange termijn

Sterke technologische verdediging tegen de risico’s van AI

AI-phishing

Een vorm van een AI-gedreven cyberaanval is AI-phishing. De tijd dat je phishing nog kon herkennen aan slechte spelling (e-mails stonden doorgaans boordevol taalfouten) is voorbij. AI schrijft inmiddels perfect Nederlands, waardoor phishing niet meer zo eenvoudig te herkennen is. Nu schrijft AI perfect Nederlands, waardoor je phishing niet meer als zodanig kunt herkennen. Bovendien kan AI in enkele seconden honderden varianten maken, elk aangepast aan een specifieke persoon. Daarom wordt het voor gewone gebruikers, maar ook voor professionals, steeds moeilijker om echt van nep te onderscheiden.

AI-Phishing verandert de spelregels

Phishing bestaat al sinds halverwege de jaren negentig, toen internet voor het grote publiek beschikbaar werd en mensen massaal online accounts en e-mail gingen gebruiken. Mensen worden dus al bijna dertig jaar actief gewaarschuwd voor deze vorm van digitale criminaliteit. Steeds meer mensen zijn dan ook alert op dit soort e-mails. Toch verandert AI-phishing de spelregels en wordt het steeds lastiger om malafide berichten te onderscheiden van bonafide berichten. Criminelen gebruiken nu AI-modellen die persoonsgegevens verzamelen, perfecte teksten genereren en zogenaamde ‘spear-phishing’ op schaal maken.

Gegevens schrapen

De persoonsgegevens worden verkregen door grote hoeveelheden (persoonlijke) data te ‘schrapen’ van social media-platformen, websites en gelekte databestanden. Zo weten criminelen waar je werkt, wat je functie is, bij welke projecten je betrokken bent, wie je manager is, wie je klanten zijn, maar ook wanneer je op kantoor of thuiswerkt. Tevens kijken ze naar bepaalde terugkerende patronen zoals bijvoorbeeld iedere woensdagavond sporten of iedere zaterdagmiddag naar het buurthuis.

Privé-informatie die jij niet als gevoelig ziet

Criminelen maken dus een volledig profiel van je online (en offline) identiteit zodat ze deze gegevens kunnen gebruiken om je later doeltreffend te overtuigen of te manipuleren. Ze gebruiken daarbij allerlei privé-informatie die jij waarschijnlijk niet als ‘gevoelig’ ziet, zoals je geboortedatum, geboorteplaats, relatiestatus, namen van je partner, kinderen of ouders, foto’s van familieleden of vrienden, en de school van je kinderen. Ze onderzoeken waar je online vaak op reageert, wat je liked op de socials, op welke momenten je meestal online bent, wat je hobby’s of interesse zijn, welke evenementen je bezocht hebt en welke producten je bekijkt of koopt.

Reputatie- en gedragssporen achterhalen

Wanneer je ondernemer bent en een bedrijf hebt, onderzoeken criminelen je financiële en zakelijke sporen. Ze gebruiken je btw-nummer, KvK-gegevens, domeinnamen die op jouw naam staan en eventuele adressen of (bedrijfs)locaties. Bovendien onderzoeken ze technische gegevens zoals welke telefoon je gebruikt (deze gegevens zijn zichtbaar in metadata), welke apps of platforms je actief gebruikt, welke posts op oude forums je hebt geplaatst en oude accounts die je zelf al bent vergeten. Door het onderzoeken van oudere berichten waarin je je mening geeft proberen ze je reputatie- en gedragssporen, politieke voorkeuren, merkvoorkeuren, muzieksmaak, seksuele geaardheid en andere persoonlijke voorkeuren in kaart te brengen. Het gaat niet alleen om online discussies van jaren terug, maar ook om bijvoorbeeld klachten die je ooit ergens geplaatst hebt.

Databreaches

Aan de hand van online kwetsbaarheden kunnen criminelen achterhalen welke wachtwoorden er zijn gelekt in zogenaamde ‘databreaches’. Dit zijn beveiligingsincidenten waarbij persoonsgegevens onopzettelijk of opzettelijk worden onthuld, gestolen, gewijzigd of vernietigd. Dit gebeurt meestal door cyberaanvallen, interne fouten of menselijke fouten. Criminelen kijken ook of je dezelfde gebruikersnaam op meerdere websites gebruikt en welke accounts niet met tweefactorauthenticatie (2FA) beveiligd zijn.

Spear-phishing

Met al deze ‘gescrapete’ gegevens kunnen criminelen je extreem realistische ‘spear-phishingberichten’ sturen, social engineering scenario’s voorbereiden, je identiteit gedeeltelijk namaken en zich voordoen als jou tegenover anderen. Het gevaar zit dus niet in één datapunt, maar in de combinatie ervan. Spear-phishing is phishing op maat. Bij gewone phishing worden er algemene berichten massaal verstuurd naar talloze personen. Deze berichten zijn vaak herkenbaar aan standaardteksten en hebben een lage succesratio, omdat je er minder snel door aangesproken voelt. Bij spear-phishing gebruiken criminelen persoonlijke informatie waardoor de berichten vertrouwd overkomen.

Berichten nauwkeurig gericht op één persoon of kleine groep

Bij spear-phishing zijn de berichten nauwkeurig gericht op één persoon of kleine groep. Deze berichten zijn helemaal aangepast (op basis van de informatie die criminelen over je hebben verzameld) aan jou en je persoonlijke situatie. Spear-phishing-berichten zijn dus veel moeilijker te herkennen, omdat er informatie in verwerkt is die is verkregen uit jouw eigen social media-, werk- of privédata. Deze malafide berichten hebben doorgaans een hoge succesratio. Met andere woorden: ze maken veel slachtoffers.

Vertrouwen en herkenning

Dat Spear-phishing-berichten meestal een hoge succesratio hebben komt door de persoonlijke informatie die erin verwerkt is. Criminelen spelen met vertrouwen en herkenning, waardoor jij denkt: ‘Hoe kan dit phishing zijn? Ze weten immers dingen die alleen familieleden, vrienden, collega’s of buren kunnen weten’. Doordat de informatie in het bericht precies past bij jouw situatie, voelt het persoonlijk en wordt je vertrouwen gewonnen (hyperpersonalisatie).

Criminelen spelen in op urgentie

Bovendien spelen criminelen in op urgentie. Ze creëren bewust tijdsdruk (je moet meteen handelen), zodat je minder nadenkt en sneller op het bericht ingaat. Ze gebruiken dan teksten als: “Kun je dit direct regelen? Het is echt dringend”, “Je account wordt binnen tien minuten geblokkeerd als je niet reageert”, “De projectleider heeft deze betaling vandaag nog nodig” en “Bel nu terug, anders loopt het mis”. Die druk zorgt ervoor dat je geen tijd neemt om te controleren of het bericht wel klopt. Urgentie is een krachtig wapen om slachtoffers direct te laten reageren, omdat het je hersenen onder druk zet. Bij tijdsdruk schakelt je brein automatisch over op snelle, automatische beslissingen. Dat is instinctief gedrag. We voelen ons verantwoordelijk en willen de situatie zo snel mogelijk “fixen”. Criminelen weten dat en misbruiken het.

Perfecte teksten zonder taal- en spellingsfouten

AI-phishing geneert perfecte teksten zonder taal- en spellingsfouten. De toon in de berichten past precies bij jouw sector, jouw functie en zelfs bij de interne bedrijfstaal. Daarom voelt een AI-phishingbericht vaak logisch en vertrouwd. En juist dat maakt deze vorm van digitale criminaliteit zo gevaarlijk. Een AI-phishingbericht kan bijvoorbeeld een e-mail zijn van ‘IT-support’ met perfect taalgebruik (jargon) en correcte handtekening, een WhatsApp van een ‘collega’ die verwijst naar een echt project waarbij je betrokken bent, een LinkedIn-bericht van een ‘recruiter’ met jouw echte cv-gegevens of een sms-bericht van ‘je bank’ dat is voorzien van het juiste logo en herkenbaar taalgebruik. In het bericht proberen de criminelen je door te linken naar een nagemaakte website waar je je wachtwoorden, codes of betaalgegevens moet invullen.

AI-vishing

Een andere vorm van AI-gedreven cyberaanvallen is AI-vishing, waarbij vaak gebruik wordt gemaakt van voice cloning. Met moderne AI heb je maar 20 tot 30 seconden audio nodig om een stem van iemand overtuigend te klonen. Die audio halen criminelen bijvoorbeeld uit TikTok-filmpjes, YouTube-video’s, Instagram-Reels, podcasts, voicememo’s in apps, livestreams, online webinars, presentaties op bedrijfswebsites, WhatsApp-voicememo’s, spraakchats in gamingplatforms en Zoom-meetings. Uit onderzoek van de Britse digitale Starling Bank is gebleken dat bijna een derde van alle volwassenen in het Verenigd Koninkrijk al eens is benaderd met een AI-stemscam. Ook in Nederland zijn inmiddels al duizenden meldingen gedaan van AI-stemfraude via telefoontjes. Veel mensen weten echter nog niet dat dit soort fraude bestaat, waardoor ze een gemakkelijk slachtoffer zijn.

Typische scenario’s

AI-vishing volgt vaak typische scenario’s. Zo kan iemand zich bijvoorbeeld voordoen als een familielid in nood. Je krijgt een telefoontje en je hoort de stem van je partner, kind of ouder, die direct geld nodig heeft. Daarbij creëren criminelen emotionele druk (urgentie) en spelen ze in op schuldgevoel of verantwoordelijkheid. Ze dwingen je tot haast om zo snel mogelijk geld over te maken, omdat er bijvoorbeeld zogenaamd sprake is van een ongeval of medische nood: “Ik lig in het ziekenhuis en heb direct geld nodig” of “ik moet nu meteen een spoedbehandeling ondergaan die niet wordt vergoed”. Ook kan de crimineel veinzen dat je familielid is gearresteerd: “Ik ben aangehouden en moet borg betalen”, “Ik heb een advocaat nodig. Kun je het voorschot overmaken?” of “De politie houdt mijn spullen vast totdat ik betaal”.

Reisproblemen in het buitenland

Criminelen spelen ook vaak in op reisproblemen in het buitenland: “Mijn portemonnee is gestolen. Ik kan niet naar huis”, “Mijn bankpas werkt niet en ik moet mijn hotel betalen” of “Ik zit vast op het vliegveld en moet een nieuw ticket kopen”. Maar het hoeft natuurlijk niet altijd om een zogenaamd ‘familielid’ in de problemen te gaan. Je kunt bijvoorbeeld ook worden gebeld door de stem van je ‘manager’ die je vraagt om snel een factuur te betalen of een vertrouwelijk document te sturen. Door AI-voice cloning klinkt het alsof je ook daadwerkelijk je échte familielid of manager aan de lijn hebt, terwijl dat niet zo is. En juist onder tijdsdruk ga je sneller de fout in.

Gedeelde herinnering

Het is natuurlijk best eng om te beseffen dat er nu technologieën zijn die de stemmen van je familieleden, vrienden, kennissen, buren en collega’s exact kunnen nabootsen. Door AI wordt het steeds lastiger om nog te kunnen bepalen wat echt is en wat nep. Toch zijn er een aantal duidelijke, praktische en goed toepasbare maatregelen die je kunt nemen om te voorkomen dat je slachtoffer wordt van AI-voice cloning. Spreek bijvoorbeeld een controlewoord af met je familielid of vraag naar een bepaalde situatie in het verleden die je ooit samen met de persoon aan de lijn hebt meegemaakt (een herinnering die alleen jullie samen delen). Criminelen kennen deze situatie of herinnering niet en kunnen daar dus ook niet op antwoorden.

Reageer niet meteen

Wanneer je een noodtelefoontje krijgt van een familielid of iemand anders die je kent, reageer dan niet meteen. Leg de telefoon neer en bel terug naar het bekende eigen nummer van de persoon. Bel niet terug naar het nummer dat jou belde, tenzij je zeker weet dat je het echte familielid aan de lijn had (door bijvoorbeeld het verifiëren van het controlewoord of de gedeelde herinnering). Laat je niet onder druk zetten. Criminelen proberen je ‘nu’, ‘direct’ of ‘meteen’ te laten handelen. Doorbreek dat patroon en neem een pauze om na te denken. Controleer iemands identiteit altijd via een tweede kanaal, zoals een bericht via een vertrouwd communicatiemiddel. Vertrouw nóóit op één telefoongesprek en maak dus ook nóóit geld over op basis van één telefoontje. Banken, politieagenten en ziekenhuizen vragen jou nooit om direct geld over te maken via de telefoon.

Houd je telefooninstellingen veilig

Houd je telefooninstellingen zo veilig mogelijk. Blokkeer onbekende nummers als dat kan, zet spamfilters en antiscam-functies aan, en houd je besturingssysteem up-to-date. Praat met familie, vrienden, kennissen en collega’s over het bestaan en het reële gevaar van AI-vishing en voice cloning. Het voorkomen van deze AI-gedreven cyberaanvallen kan alleen als iedereen weet dat deze vorm van misdaad bestaat.

Bescherming van kwetsbare mensen

Vooral ouderen zijn extra kwetsbaar voor deze AI-gedreven cyberaanvallen. Daarom is het belangrijk dat je hen helpt om alert te blijven. Leg in simpele bewoordingen uit dat stemmen tegenwoordig nagemaakt kunnen worden. Spreek samen een controlewoord af en oefen met hen wat ze moeten doen bij een onverwacht noodtelefoontje van iemand die ze ‘zogenaamd’ kennen. Vertel hun dat ze altijd moeten ophangen en zélf terugbellen naar het bekende echte nummer van de persoon die belt. Herhaal dat ‘tijdsdruk’ en ‘urgentie’ veelgebruikte methoden zijn door criminelen, en dat geen enkele organisatie vraagt om directe betalingen te doen via de telefoon. Maak een telefoon zo veilig mogelijk door spamfilters, updates en beveiligingsopties in te schakelen. Door er regelmatig met hen over te praten blijven ouderen beter beschermd tegen deze nieuwe vorm van digitale oplichting.

Deepfake-fraude

Naast AI-phishing en AI-vishing worden ook steeds meer mensen slachtoffer van ‘deepfake-fraude’. Een deepfake is een door AI gegenereerde of zwaar gemanipuleerde video, foto of audio-opname. De deepfakes lijken echt, maar zijn dat niet. Inmiddels is deze techniek goedkoop en eenvoudig geworden en maken criminelen er gretig gebruik van. Voor een euro kun je al een realistische deepfake maken, terwijl de totale economische schade wereldwijd in de miljarden loopt. Het aantal deepfake-bestanden is in de afgelopen jaren enorm gestegen.

Deepfake-fraude tijdens online vergadering

AI-gedreven misdaad zoals deepfake-fraude kan op grote schaal reputaties beschadigen. Deepfakes zijn nauwelijks nog met het blote oog te herkennen. Een opvallende deepfake-fraudezaak vond plaats in 2024. Een nietsvermoedende medewerker van een bedrijf in Hong Kong nam deel aan een online vergadering waarin de CFO en enkele collega’s verschenen. In het gesprek gaf de ‘CFO’ opdracht om meerdere grote betalingen uit te voeren. Omdat de vergadering er echt uitzag en iedereen vertrouwd klonk, voerde de medewerker de overboekingen uit. Echter bleek later dat de CFO en de collega’s waren gecreëerd met behulp van deepfake. In totaal werd ruim 25 miljoen dollar weggesluisd. Deze zaak laat zien hoe ver criminelen bereid zijn te gaan en hoe geloofwaardig deepfake-fraude kan zijn. Daarom is het belangrijk dat organisaties strengere controles toepassen bij financiële verzoeken, zelfs tijdens een ogenschijnlijk normale videovergadering.

BN’ers steeds vaker slachtoffer van deepfake-fraude

Steeds vaker worden er deepfake-filmpjes met bekende personen, zoals investeerders, experts of artiesten ingezet om nepinvesteringen of nep-cryptoprojecten te promoten. Ook in Nederland duiken steeds vaker deepfake-video’s op waarin BN’ers worden misbruikt voor oplichting. Zo werden onder meer Arie Boomsma, Monica Geuze en neuropsycholoog Erik Scherder ongewild het ‘gezicht’ van nep-supplementen. Hun stemmen en gezichten werden gemonteerd in overtuigende video’s die online rondgingen. Ook demissionair premier Dick Schoof werd slachtoffer van deze praktijken. Zijn beeltenis verscheen in een deepfake-filmpje dat een vals investeringsplatform promootte.

Onduidelijk hoe deepfake-video’s worden gemaakt

Meestal is onduidelijk hoe een deepfake-video precies gemaakt is: ging het om de montage, animatie of echte AI-cloning? Deze technische details blijven meestal verborgen. Ook weten we zelden hoeveel mensen daadwerkelijk zijn opgelicht door één specifieke video. De financiële schade, het aantal slachtoffers en de verspreiding blijven doorgaans vaag. Bovendien is het in veel gevallen onduidelijk of de bekende persoon in de video überhaupt weet dat zijn of haar beeld is misbruikt, en of juridische stappen wellicht mogelijk zijn. Juist deze onzekerheden maken deepfake-fraude zo gevaarlijk. Ze laten zien dat het geen toekomstscenario is, maar een realiteit die iedereen (bekend of onbekend) kan raken. En precies daarom is alertheid op deze geavanceerde AI-technologie zo belangrijk.

Paniek op de beurs

Een deepfake-foto van een explosie bij het Pentagon liet in 2023 zien hoe gevaarlijk AI-beelden kunnen zijn. De afbeelding leek echt en verspreidde zich razendsnel via sociale media. Binnen enkele minuten reageerden beleggers en zakte de beurs kort door de ontstane paniek. Later bleek dat er helemaal geen explosie was geweest en dat de foto volledig AI-gegeneerd was. Dit incident toont aan hoe één overtuigend nepbeeld de financiële markten kan ontregelen en hoe snel deepfake-beelden maatschappelijke onrust kunnen veroorzaken.

Ondermijning van democratische processen

Doordat AI-systemen hyperrealistische nepvideo’s kunnen maken die eruitzien alsof ze echt zijn, kunnen criminelen en propagandamakers eenvoudig beelden creëren van rellen, verkiezingsfraude of politieke schandalen. Zulke deepfake-video’s verspreiden zich snel en zaaien twijfel over wat wel en wat niet klopt. Dat ondermijnt het vertrouwen in nieuws én in de democratische processen die daarvan afhankelijk zijn.

Overtuigende chantagemails en sextortion

AI-gedreven cyberaanvallen maken chantagemails en sextortion veel overtuigender. Waar oude dreigmails vaak nog vol spel- en taalfouten stonden, schrijven criminelen nu perfecte, foutloze teksten die professioneel en betrouwbaar lijken. Soms voegen ze zelfs nep-screenshots of deepfake-beelden toe om extra druk op hun slachtoffers te zetten. Ook gebruiken ze persoonlijke gegevens die ze online hebben gevonden. Zo lijkt de dreiging echt, terwijl er vaak helemaal geen beelden bestaan. Door die combinatie van foutloze taal, nepbewijzen en persoonlijke details trappen slachtoffers sneller in de val.

AI maakt identiteitsfraude makkelijker

AI maakt identiteitsfraude veel makkelijker. Criminelen verzamelen met AI-tools razendsnel persoonlijke gegevens en bouwen complete profielen die eruitzien alsof ze echt zijn. Met AI-gegenereerde portretten openen ze neprekeningen bij banken, webshops en cryptodiensten. Ze vervalsen identiteitsbewijzen, loonstrookjes en documenten die zo echt lijken dat controles ze niet altijd herkennen. Sommige tools maken zelfs nep-selfies voor zogenaamde ‘live checks’. Daardoor wordt het steeds eenvoudiger om onder een valse identiteit geld wit te wassen, aankopen te doen of fraude te plegen – vaak zonder dat slachtoffers doorhebben dat hun gegevens worden misbruikt. Deepfakes van criminelen raken je niet alleen in je portemonnee, maar ze tasten ook het vertrouwen in mensen, bedrijven en instituties aan.

Nieuwe risico’s door AI-fraude

Door kunstmatige intelligentie ontstaan geheel nieuwe risico’s. Aanvallers kunnen in enkele minuten duizenden unieke e-mails versturen, binnen een paar uur honderden stemmen of gezichten klonen en 24/7 scripts draaien die data verzamelen, testen en aanpassen. Daardoor mislukken veel aanvallen, maar een klein percentage is al genoeg voor grote winst. Vroeger had je veel technische kennis nodig voor deze criminele acties, maar nu kan bijna iedereen met een laptop en wat online tutorials stevige aanvallen uitvoeren. De drempel om ‘maar eens wat te proberen’ wordt dan ook lager.

Liar’s dividend

Aan deepfakes kleeft nog een ander subtiel risico. Doordat deepfakes bestaan, kan iedereen achteraf zeggen: “Dat was nep” (liar’s dividend). Dat betekent dat échte opnames kunnen worden ontkend en het bewijs in rechtszaken minder vanzelfsprekend is. Met andere woorden: het vertrouwen in video en audio als bewijs daalt aanzienlijk.

Generatieve AI

Generatieve AI is kunstmatige intelligentie die zelf nieuwe content (teksten, beelden en stemmen) kan maken op basis van wat hij heeft geleerd van bestaande voorbeelden, om daarna iets te creëren dat nog niet eerder bestond. Criminelen kunnen generatieve AI niet alleen gebruiken voor het maken van realistische nepstemmen, maar ook voor slimme toepassingen, zoals het sneller maken van ontwerpen of het schrijven van duidelijke berichten. Deze krachtige techniek krijgt dan ook steeds meer invloed op ons dagelijks leven. Criminelen misbruiken generatieve AI vooral om beelden en stemmen van kinderen na te maken, en om ouderen te misleiden die minder digitaal vaardig zijn. Europese analyses waarschuwen dat AI-assisted fraude en scam calls toenemen en vrijwel alle vormen van georganiseerde misdaad raken. Daarnaast groeit de zorg over de impact van generatieve AI op kinderen, hun privacy en veiligheid online.

AI-gedreven cyberaanvallen herkennen en voorkomen

AI-gedreven cyberaanvallen maken gebruik van ingewikkelde technieken, maar de belangrijkste verdedigingsmethoden zijn verrassend simpel. Als je twijfelt of je onder druk wordt gezet door ‘iemand’ die je denkt te kennen (of iemand die je niet kent) neem dan altijd een pauze. Neem de tijd om zelf eerst uit te zoeken of degene door wie je benaderd wordt te goeder trouw is. Wordt je onder druk gezet? Moet er nu meteen iets? Dan is pauze de beste eerste stap. Gebruik altijd een tweede kanaal om de contactpersoon te verifiëren. Krijg je een vreemd verzoek via e-mail of WhatsApp? Bel de persoon dan via een bekende route terug. Niet via het telefoonnummer in het bericht.

Nooit vanuit een e-mail doorklikken naar je bank

Deel nóóit gevoelige informatie via kliklinks. Ga nooit naar je bank via een link in een e-mail, maar type zelf in je browser de url in. Of gebruik je eigen officiële app op je smartphone. Dan weet je zeker dat je in de officiële online bankomgeving van je bank terechtkomt. Controleer altijd het adres en kijk naar het domein van de afzender en de website. Kleine verschillen (zoals bijvoorbeeld .net in plaats van .nl) zijn verdacht.

Hoe bescherm ik mezelf tegen AI-phishing?

Om jezelf optimaal tegen AI-phishing te beschermen moet je unieke wachtwoorden en een wachtwoordmanager gebruiken. Zet tweestapsverificatie (2FA) aan bij al je belangrijke accounts. Stap waar mogelijk over op passkeys of ‘FIDO-beveilingssleutels’ (een fysiek hardware-apparaat voor extra beveiliging bij het inloggen). Deze hardware-apparaten vervangen of versterken wachtwoorden met behulp van cryptografie en werken via USB, NFC of Bluetooth). Deze methode is van zichzelf phishing-resistent, omdat er geen wachtwoord is dat je kunt afgeven. Wees extra alert op berichten die spelen met angst, urgentie of beloning.

Passkeys

Veel bedrijven en consumenten stappen over op wachtwoordloos inloggen (zogenaamde passkeys). Passkeys zijn de opvolger van het traditionele wachtwoord. Je logt veilig in zonder iets te onthouden. Een passkey werkt met je telefoon of laptop en controleert je identiteit met Face ID, vingerafdruk of een pincode. Daardoor hoef je nooit meer een wachtwoord in te tikken of te wijzigen. Het grote voordeel: passkeys zijn veel beter bestand tegen AI-gedreven cyberaanvallen en datalekken dan gewone wachtwoorden. Ze zijn uniek per account en je privésleutel blijft altijd op je eigen apparaat. Inloggen gaat sneller, veiliger en zonder gedoe. Daarom stappen steeds meer organisaties, instellingen en diensten over op passkeys. Met passkeys maak je je online leven meteen een stuk veiliger.

Steeds meer diensten ondersteunen passkeys

Steeds meer diensten (waaronder Google, Apple ID, Microsoft accounts, WhatsApp, PayPal, Amazon, banken en grote webshops) ondersteunen passkeys. Het werkt heel eenvoudig. Je gaat in een account naar ‘beveiliging’. Je kiest ‘Passkey instellen’ en selecteert je telefoon, laptop of hardwaresleutel. Bevestig vervolgens met Face ID, vingerafdruk of pincode. Je passkeys worden veilig gesynchroniseerd via iCloud (Apple), Google Passkeys (Android/Chrome) of Microsoft Authenticator. Je kunt dus ook op ander apparaten inloggen.

Hoe kunnen organisaties passkeys inzetten?

Organisaties kunnen passkeys invoeren via Identity & Acces Management (IAM), Single Sign-On (SSO), Passwordless inloggen in Microsoft Entra ID (voorheen Azure AD) en via Okta, PingID, Duo Security en andere Zero Trust-platformen. De voordelen van passkeys voor organisaties zijn groot: geen wachtwoordbeheer meer, minder helpdesk-tickets (“wachtwoord vergeten”) en een veel hogere beveiliging. Bovendien hoeven gebruikers niets te leren en kunnen ze de passkeys direct gebruiken. Passkeys passen dan ook perfect in een Zero Trust beveiligingsstrategie.

Aandachtspunten ten aanzien van passkeys

Ondanks de voordelen zijn er ten aanzien van passkeys echter ook nog een aantal aandachtspunten waarmee particulieren en organisaties rekening moeten houden. Nog niet alle diensten ondersteunen passkeys, je moet back-ups inschakelen (iCloud/Google) en het beheer van meerdere apparaten moet goed geregeld zijn. Desondanks lossen passkeys zonder enige twijfel de grootste risico’s van wachtwoorden op: geen phishing, geen wachtwoordhergebruik, geen brute-force en geen datalekken van wachtwoordbestanden. Uiteindelijk zullen naar verwachting de traditionele wachtwoorden verdwijnen en passkeys de beveiliging overnemen, wat goed nieuws is voor de online veiligheid.

Bescherming tegen AI-vishing (voice cloning)

Spreek met je gezinsleden, andere familieleden en vrienden een veilig woord of zin af. Bijvoorbeeld een detail uit een gezamenlijke herinnering. Krijg je een noodoproep met een geldverzoek? Bel dan direct terug op het bij jou bekende nummer, of maak een videogesprek met een extra controlevraag. Bel in ieder geval nooit terug naar het onbekende nummer dat jou belde. Deel niet onnodig veel spraakfragmenten openbaar en denk na over wat je op sociale media zet.

Hoe bescherm ik mezelf tegen deepfake-criminaliteit?

Je kunt deepfakes helaas niet altijd herkennen. Toch kun je de risico’s beperken. Geloof niet altijd meteen wat je ziet of hoort. Zoek naar bevestiging in meerdere betrouwbare bronnen. Ga nooit over tot betaling of het delen van gevoelige data alleen op basis van een video- of audiofragment. Meld verdachte video’s op verschillende platformen en waarschuw mensen in je omgeving.

Hoe kunnen organisaties zich beschermen tegen AI-gedreven cyberaanvallen?

Voor organisaties ligt de lat om zich optimaal te beschermen tegen AI-gedreven aanvallen veel hoger. Zij zijn immers een aantrekkelijk doelwit voor criminelen en fouten hebben doorgaans een grote impact. Daarom moeten organisaties duidelijke verificatieprocessen instellen en nooit grote bedragen betalen op basis van één e-mail, chat of call. Het is verstandig om minimaal twee onafhankelijke controles (vier-ogenprincipe) te eisen en vast te leggen dat betaalverzoeken boven een bepaalde drempel altijd via een tweede kanaal worden geverifieerd. Tevens is het verstandig voor organisaties om herkenbare, vaste procedures en woorden te gebruiken, zodat afwijkingen direct opvallen.

Realistische oefencampagnes voor medewerkers

Om de risico’s van op AI-gebaseerde criminaliteit te minimaliseren moeten organisaties waar mogelijk phishing-resistente Multi‑Factor Authentication (MFA) toepassen, maar ook gebruik maken van passkeys, FIDO2-sleutels of WebAuthn-oplossingen. Ook moeten bedrijven en instellingen het gebruik van sms-codes en e-mailcodes verminderen en toegangsrechten segmenteren: niet iedereen heeft overal toegang toe. Bovendien moeten organisaties medewerkers trainen met realistische oefencampagnes rond AI-phishing, voice cloning en deepfake-fraude. Gebruik concrete voorbeelden uit de eigen specifieke sector. Gebruik tools die deepfake-patronen en afwijkend gedrag herkennen. Monitor uitgaand en inkomend verkeer op opvallende patronen en werk intensief samen met sector- of branche-initiatieven rond AI-fraude.

AI-modellen worden steeds beter

AI-gedreven cyberaanvallen gaan niet meer weg. Integendeel! De AI-modellen worden steeds beter, de aanvallen worden persoonlijker en de schaal blijft groeien. Toch ben je niet machteloos tegen deze vorm van digitale criminaliteit. Met een combinatie van gezond wantrouwen, duidelijke verificatiestappen, sterke authenticatie (bijvoorbeeld passkeys) en bewuster omgaan met je eigen data en stem kun je de risico’s van misbruik al fors verlagen. Of je nu particulier, zzp’er, mkb’er of security-professional bent: nu is het moment om je processen, gewoontes en beveiliging te herzien. Want AI-fraude wordt steeds geavanceerder en veel moeilijker als zodanig te herkennen.

Voorkomen dat je identiteitsfoto wordt misbruikt op social media

Om misbruik van je identiteitsfoto te voorkomen moet je beperken wat je online deelt. Plaats nooit complete documenten online en voeg altijd een watermerk toe. Verlaag de resolutie, stel je privacy-instellingen strakker in en verzend foto’s alleen via veilige kanalen. Vraag bovendien altijd waarom een identiteitsfoto nodig is. Zie je onverwacht gebruik van je naam of beeltenis? Meld dit dan direct. Met deze simpele stappen houd je controle, verklein je risico’s en bescherm je jezelf zichtbaar beter tegen misbruik.

Nieuwe AI-bedreigingen

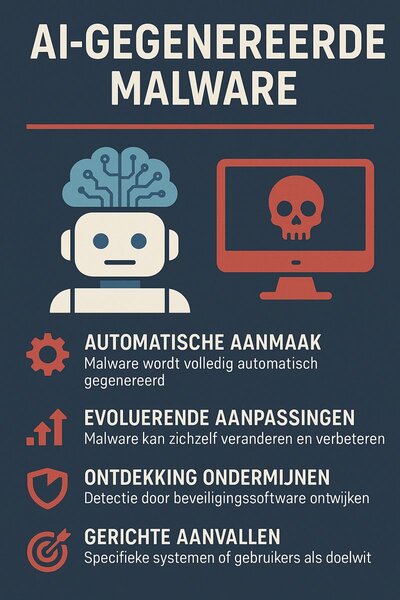

Bovenstaande voorbeelden van AI-gedreven cyberaanvallen komen momenteel vaak voor, maar er is nog een veel grotere en groeiende reeks risico’s van reële gevaren en nieuwe AI-bedreigingen die op ons afkomen. Volgens analyses van de Nederlandse veiligheidsdiensten AIVD, NCTV en MIVD zal kunstmatige intelligentie vrijwel alle bestaande bedreigingen (zoals hacken, het verspreiden van desinformatie en staats- of spionageactiviteiten) versterken. Naast phishing en deepfakes, worden ook geavanceerde, AI-gegenereerde malware en polymorfe malware gebruikt. Dit is software die zichzelf voortdurend wijzigt om detectie te ontwijken.

AI-gegenereerde malware

AI-gegenereerde malware wordt door kunstmatige intelligentie ontworpen of aangepast. De malware leert van defensiemaatregelen en kan daardoor automatisch nieuwe varianten maken. AI helpt aanvallers sneller, gerichter en creatiever te worden. Het gaat dus om malware die zichzelf optimaliseert, betere routes zoekt of specifieke doelen kiest. De AI bepaalt hoe de malware precies verandert en beslissingen neemt. Wanneer AI-genereerde malware voortdurend van vorm, structuur én gedrag verandert om detectie te ontwijken, spreekt men ook wel van: ‘shape-shifting’.

Polymorfe malware

Polymorfe malware is malware die bij elke verspreiding van gedaante verandert, vooral in code- of bestandsstructuur. Het doel van deze AI-gedreven cyberaanvallen is eenvoudig: antivirussoftware misleiden. De functionaliteit blijft gelijk, maar de ‘buitenkant’ verandert automatisch door ingebouwde algoritmes. De malware verandert dus alleen de vorm, niet de strategie. Het belangrijkste verschil tussen AI-gegenereerde malware en polymorfe malware is dat AI-gegenereerde malware ‘intelligentie’ gebruikt om zichzelf constant te verbeteren, varianten te creëren en beslissingen te nemen. Polyforme malware verandert vooral de codesignatuur om herkenning te voorkomen, maar zonder ‘intelligent’ gedrag.

AI-gedreven automatisering van grootschalige cyberaanvallen

Kunstmatige intelligentie verlaagt de drempel voor criminelen om grootschalige cyberaanvallen uit te voeren. Ze kunnen met weinig middelen zeer snel en goedkoop hele effectieve identiteitsfraude- phishing- deepfake- en social-engineeringcampagnes opzetten. Dat betekent dat de schaal en het volume van deze aanvallen de komende jaren explosief kunnen groeien, en dat traditionele verdediging tegen deze nieuwe misdaadvormen mogelijk overbelast raakt.

Adversarial AI

Ook Adversarial AI draait om het slim misleiden van kunstmatige intelligentie. Aanvallers passen beelden, tekst of data heel subtiel aan, waardoor een AI totaal verkeerde keuzes maakt. Een systeem herkent dan bijvoorbeeld een stopbord bij een kruispunt ineens als iets anders, of geeft fout advies op basis van misleidende input. Deze AI-gedreven cyberaanvallen lijken klein, maar de impact is groot. Ze ondermijnen immers de veiligheid van systemen die we allemaal dagelijks gebruiken, van gezichtsherkenning tot fraudedetectie. Daarom is het belangrijk om te begrijpen hoe Adversarial AI precies werkt en waarom deze vorm van manipulatie steeds vaker door criminelen wordt gebruikt.

Data poisoning

Data poisoning is een AI-gedreven cyberaanval die de kern van een AI-systeem aanvalt. Kwaadwillenden voegen misleidende of schadelijke data toe aan de trainingsset, waardoor het model verkeerde patronen leert. De trainingsdata wordt dus gemanipuleerd. Het gevolg laat zicht raden: het systeem maakt fouten, mist dreigingen of reageert precies zoals de aanvaller wil. Deze subtiele manipulatie is moeilijk te zien, maar heeft grote impact. Daarom is het cruciaal om datasets te beschermen en voortdurend te controleren op vreemde afwijkingen. Data poisoning laat namelijk goed zien hoe kwetsbaar AI wordt zodra de basisdata niet betrouwbaar is.

Model inversion

Bij model inversion sturen aanvallers gerichte vragen naar het systeem en reconstrueren ze op basis van gegevens die nooit zichtbaar mochten worden. Denk bijvoorbeeld aan gezichtskenmerken, persoonlijke details of medische informatie. Het model wordt niet gehackt, maar onthult toch meer dan bedoeld. Daarom groeit ook de zorg rond privacy en databeveiliging. Model inversion onderstreept dat getrainde modellen zelf een risico vormen wanneer de onderliggende data niet goed is afgeschermd. Model inversion laat dus zien hoe kwetsbaar AI kan zijn zodra een model gevoelige data bevat.

Prompt injection

Prompt injection laat zien hoe kwetsbaar AI kan worden door één slimme zin. Aanvallers voegen misleidende instructies toe aan de input, waardoor het model regels negeert of gevoelige informatie prijsgeeft. Er is dus geen hack nodig, maar alleen de juiste woorden op het juiste moment. Daardoor is er steeds meer bezorgdheid ten aanzien van AI-beveiliging. Prompt injection maakt duidelijk dat betrouwbare systemen niet alleen sterke modellen nodig hebben, maar vooral input die niet te manipuleren is. Adversarial AI, data poisoning, model inversion en prompt injection maken dus misbruik van kwetsbaarheden in AI-modellen, waardoor aanvallers de verdediging kunnen ondermijnen, data kunnen manipuleren of een AI inzetten voor kwaadaardige taken.

Risico’s rondom biometrie en deepfake-spoofing

Steeds meer systemen vertrouwen op biometrie (gezichts- of vingerafdruk en stemherkenning). Biometrie biedt ons gemak, maar brengt ook nieuwe risico’s met zich mee. Biometrische gegevens kunnen immers worden misbruikt. Deepfake-technieken maken het mogelijk om biometrische ‘spoofing’ te plegen, waarbij stemmen of beelden worden nagemaakt om authenticatie te misleiden. Een wachtwoord kun je vervangen, maar dat dat geldt niet voor een gezicht of stem. Daardoor blijft een lek van biometrische data altijd een probleem. Deepfake-spoofing maakt dat risico nog groter. Met realistische nepbeelden en nagemaakte stemmen kunnen criminelen verificaties omzeilen en identiteiten kapen. De grens tussen echt en vals vervaagt snel, waardoor detectie steeds lastiger wordt. Daarom groeit de noodzaak om biometrische systemen beter te beschermen en misleiding vroeg te herkennen. Moderne, ‘sterke’ authenticatie garandeert namelijk niets als het door geavanceerde AI wordt misbruikt.

Risico’s van AI-integratie in kritieke infrastructuren en IoT

AI-gedreven cyberaanvallen kunnen zich richten op systemen buiten de ‘gewone IT’, zoals de energievoorziening, vervoer, gezondheidszorg en slimme apparaten (IoT-netwerken). Daardoor kunnen sabotage, logistieke verstoringen en spionage veel directer impact hebben op kritieke infrastructuren in de echte wereld. Experts waarschuwen dat deze dreigingen zichtbaar toenemen, juist omdat AI steeds meer processen aanstuurt. De noodzaak om deze systemen beter te beveiligen wordt daarom elke dag urgenter.

Massale desinformatie

Kunstmatige intelligentie maakt het steeds makkelijker om massale desinformatie te verspreiden, en dat vormt een direct bedreiging voor onze democratie. Deepfake in video, audio en beeld worden zo geloofwaardig dat kwaadwillenden zonder moeite nepnieuws, vervalste politieke uitspraken of gesimuleerde rellen kunnen verspreiden. Zulke misleidende content ondermijnt het vertrouwen in media, overheden en verkiezingen. Experts waarschuwen er dan ook voor dat toekomstige AI-systemen dit probleem alleen maar groter maken. Het risico bestaat zelfs dat we op termijn nauwelijks nog kunnen vaststellen wat echt is en wat bewust gemanipuleerd is.

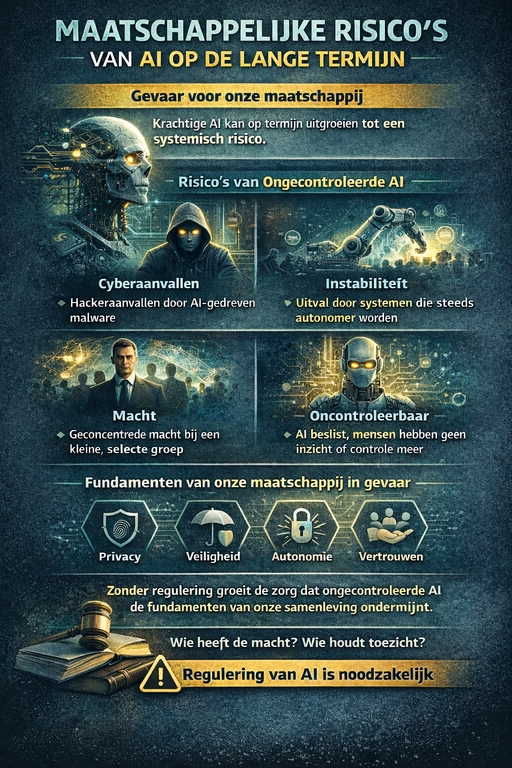

Maatschappelijke risico’s van AI-gedreven cyberaanvallen op de lange termijn

Krachtige AI kan op lange termijn uitgroeien tot een systemisch risico. Niet alleen door AI-gedreven cyberaanvallen, maar ook door instabiliteit in systemen die steeds autonomer worden. Zonder goede regulering van AI-technologieën verschuift macht naar een kleine groep, terwijl AI beslissingen kan nemen die mensen niet meer volledig controleren. Dat raakt direct aan de kern van onze samenleving: privacy, veiligheid, autonomie en vertrouwen. Daarom groeit de zorg dat ongecontroleerde kunstmatige intelligentie de fundamenten van onze maatschappij kan ondermijnen.

Veel kansen, maar de risico’s van AI groeien zichtbaar mee

Toekomstige AI kan zo krachtig worden dat traditionele beveiliging tekortschiet. Zelflerende aanvalssystemen, grootschalige biometrische spoofing en extreem realistische deepfakes vergroten het risico op misleiding en sabotage. Bovendien zorgen slimme IoT-netwerken en autonome besluitvorming ervoor dat één kwetsbaarheid zich direct razendsnel door hele systemen kan verspreiden. Zo vervaagt langzaam het onderscheid tussen echt en nep, en tussen veiligheid en dreiging. AI-technologieën bieden weliswaar volop kansen, maar de risico’s groeien zichtbaar mee.

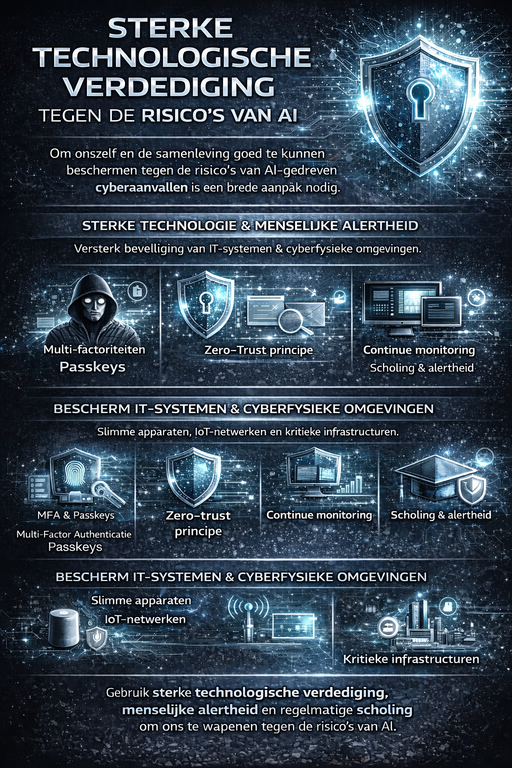

Sterke technologische verdediging tegen de risico’s van AI

Om onszelf en de samenleving goed te kunnen beschermen tegen de risico’s van AI-gedreven cyberaanvallen is een brede aanpak nodig. We moeten steeds alerter worden op sociale manipulatie, want criminelen misleiden steeds vaker met nepidentiteiten, deepfakes en overtuigende berichten. Daarom is het belangrijk om een sterke technologische verdediging toe te passen (zoals MFA, passkeys, zero-trust en continue monitoring) met menselijke alertheid en regelmatige scholing. Investeer in beveiliging van zowel IT-systemen als cyberfysieke omgevingen. Slimme apparaten, IoT-netwerken en kritieke infrastructuren kunnen immers snel kwetsbaar worden zodra één schakel faalt.

Grip op de dreigingen van morgen

Samenwerking is essentieel: goede regelgeving omtrent AI, duidelijke afspraken en sterke coalities helpen de risico’s beperken. Onderzoek en publieke bewustwording zijn dan ook cruciaal. Door AI-systemen continue te controleren en mensen en organisaties goed te informeren, houden we grip op de dreigingen van morgen. Alleen dan bouwen we stap voor stap aan een toekomst waarin deze technologie ons versterkt in plaats van overweldigt.